間違ったフレームワークを選択すると、数週間の手戻りにつながるアーキテクチャ上の問題を引き起こす可能性があります。

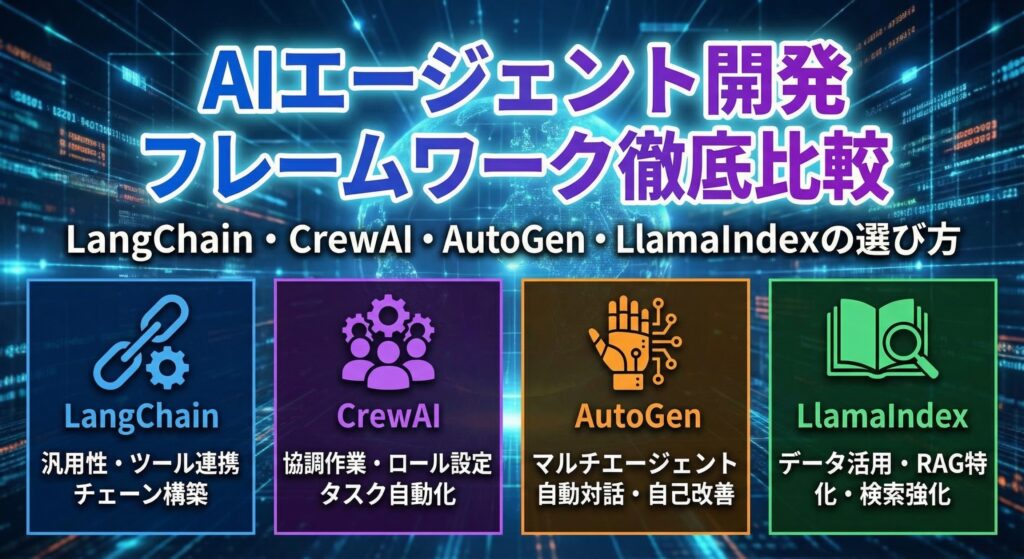

2025年現在、LangChain、CrewAI、AutoGen、LlamaIndexなど多数のAIエージェント開発フレームワークが存在し、それぞれ異なるアプローチと強みを持っています。「とりあえずLangChainで」という選択が、プロジェクト後半で大きな技術的負債となるケースも少なくありません。

本記事では、主要なAIエージェント開発フレームワークを技術的な観点から徹底比較し、プロジェクトに最適なフレームワークを選ぶための指針を提供します。

AIエージェント開発フレームワークとは

フレームワークが必要な理由

AIエージェントを一から開発するには、以下のような複雑な機能を実装する必要があります:

- LLM連携:OpenAI、Anthropic、Google等のAPIとの通信

- プロンプト管理:テンプレート、チェーン、変数管理

- メモリ機能:会話履歴、長期記憶の保持

- ツール統合:外部API、データベース、ファイルシステムとの連携

- エージェント協調:複数エージェントの連携・オーケストレーション

- 状態管理:ワークフローの進行状況、中間結果の管理

フレームワークを使用することで、これらの共通機能を再発明することなく、ビジネスロジックの実装に集中できます。

主要フレームワークの位置づけ

LangChain / LangGraph:汎用オーケストレーター(最も広く採用)

CrewAI:ロールベースのマルチエージェント協調

AutoGen:会話駆動型エージェント(Microsoft)

LlamaIndex:データ検索・RAG特化

OpenAI Agents SDK:OpenAI公式フレームワーク

主要フレームワーク詳細比較

1. LangChain / LangGraph

概要:2022年登場以来、AIエージェント開発のデファクトスタンダードとして急速に普及したフレームワーク。

特徴

- モジュラー設計:コンポーネントを自由に組み合わせ可能

- 豊富な統合:100以上のLLM、ベクトルDB、ツールに対応

- LangGraph:グラフベースのステートフルなワークフロー構築

- LangSmith:デバッグ・モニタリングツール

- 最大のコミュニティ:ドキュメント、チュートリアルが豊富

LangGraphの特徴

LangGraphは、ワークフローを有向グラフ(DAG)として表現します。各ノードが特定のタスクや関数を表し、条件分岐、並列処理、ループが可能です。

[入力] → [分類ノード] → [条件分岐] → [処理A] or [処理B] → [出力]

適したユースケース

- 複雑な条件分岐を持つワークフロー

- Human-in-the-Loop(人間の介入)が必要なシステム

- 高度なエラーハンドリング・リカバリが必要な場合

- 本番環境での大規模運用

注意点

- 学習コストが高い:グラフ、状態管理の概念理解が必要

- ドキュメントが技術的で初心者には難しい

- シンプルなタスクには過剰な場合がある

| 言語 | Python / JavaScript |

| 学習コスト | 高 |

| 柔軟性 | 非常に高い |

| コミュニティ | 最大 |

| GitHub Stars | 100K+ |

2. CrewAI

概要:「チームワーク」をコンセプトに、エージェントを役割(Role)と目標(Goal)を持つチームメンバーとして抽象化するフレームワーク。

特徴

- 直感的なAPI:Agent、Task、Crewの3つの概念でシンプルに構築

- 自動タスク委任:エージェント間でタスクを自動的に割り振り

- YAML設定:コード量を削減、設定ファイルでエージェント定義

- ビルトインツール:Web検索、データ分析などが統合済み

- 詳細なログ:デバッグがしやすい

コード例

from crewai import Agent, Task, Crew

# エージェント定義

researcher = Agent(

role="リサーチャー",

goal="最新のAI動向を調査する",

backstory="あなたは優秀なリサーチアナリストです"

)

writer = Agent(

role="ライター",

goal="調査結果を記事にまとめる",

backstory="あなたは経験豊富なテクニカルライターです"

)

# タスク定義

research_task = Task(

description="2025年のAIエージェント市場を調査",

agent=researcher

)

# クルー(チーム)実行

crew = Crew(agents=[researcher, writer], tasks=[research_task])

result = crew.kickoff()

適したユースケース

- コンテンツ制作パイプライン(リサーチ→執筆→編集)

- レポート生成システム

- 品質保証ワークフロー

- 初心者〜中小規模プロジェクト

注意点

- 複雑なカスタマイズには追加の労力が必要

- LangChainと比較するとコミュニティが小さい

| 言語 | Python |

| 学習コスト | 低〜中 |

| 柔軟性 | 中 |

| コミュニティ | 成長中 |

| GitHub Stars | 25K+ |

3. AutoGen(Microsoft)

概要:Microsoftが開発した、会話(Conversation)を中心としたマルチエージェントフレームワーク。

特徴

- 会話駆動型:エージェント間のやり取りを会話として表現

- 柔軟なトポロジー:1対1、グループチャット、階層型など多様な構成

- Human-in-the-Loop:人間の介入を簡単に組み込める

- AutoGen Studio:ノーコードGUIツールも提供

- コード実行:エージェントがPythonコードを生成・実行可能

適したユースケース

- ブレインストーミング、アイデア出し

- カスタマーサポート

- マルチエージェントQ&A

- 会議シミュレーション

注意点

- ドキュメントのバージョン管理が混乱気味

- 手動セットアップが必要な部分がある

| 言語 | Python |

| 学習コスト | 中 |

| 柔軟性 | 高 |

| コミュニティ | 成長中 |

| GitHub Stars | 40K+ |

4. LlamaIndex

概要:データ検索・RAG(Retrieval-Augmented Generation)に特化したフレームワーク。「自分のデータ上で動くエージェント」を作るのに最適。

特徴

- データインジェスト:PDF、DB、API等からデータを取り込み

- 高度なインデックス:ベクトル、キーワード、ナレッジグラフ対応

- クエリエンジン:自然言語でデータを検索

- RAG最適化:チャンキング、リランキング等の機能が充実

適したユースケース

- 社内ナレッジベース検索

- ドキュメントQ&Aシステム

- データ集約型のエージェント

- RAGシステム構築

他フレームワークとの組み合わせ

LlamaIndexは単体でも使えますが、CrewAIやLangChainと組み合わせて使うケースも多いです。LlamaIndexでデータ検索を行い、その結果を他のエージェントに渡す構成が一般的です。

| 言語 | Python / TypeScript |

| 学習コスト | 中 |

| 柔軟性 | 中(RAG特化) |

| コミュニティ | 大 |

| GitHub Stars | 40K+ |

5. OpenAI Agents SDK

概要:OpenAIが提供する公式のエージェント開発フレームワーク。2025年に登場した新しい選択肢。

特徴

- OpenAI統合:GPT-4o、GPT-4 Turboとのシームレスな連携

- シンプルなAPI:最小限のコードでエージェント構築

- ビルトイン機能:ツール呼び出し、コード実行が標準装備

- 公式サポート:OpenAIによるメンテナンス

注意点

- OpenAIモデルに依存(他のLLMとの互換性は限定的)

- 比較的新しく、エコシステムがまだ発展途上

フレームワーク比較表

| フレームワーク | アプローチ | 学習コスト | 柔軟性 | 最適なユースケース |

|---|---|---|---|---|

| LangChain/LangGraph | グラフベース | 高 | 非常に高 | 複雑なワークフロー、本番運用 |

| CrewAI | ロールベース | 低 | 中 | コンテンツ制作、チーム協調 |

| AutoGen | 会話駆動 | 中 | 高 | ブレスト、カスタマーサポート |

| LlamaIndex | データ検索 | 中 | 中 | RAG、ナレッジベース |

| OpenAI SDK | シンプル | 低 | 低〜中 | OpenAI中心の開発 |

フレームワーク選定フローチャート

Q1. RAG/データ検索が主な用途ですか?

→ Yes → LlamaIndex(必要に応じて他と組み合わせ)

→ No → Q2へ

Q2. 複数エージェントの協調が必要ですか?

→ Yes → Q3へ

→ No → LangChain or OpenAI SDK

Q3. エージェント間のやり取りは会話形式ですか?

→ Yes(会話・ブレスト) → AutoGen

→ No(タスク実行) → Q4へ

Q4. 複雑な条件分岐・状態管理が必要ですか?

→ Yes → LangGraph

→ No → CrewAI

2025年の注目トレンド:MCP(Model Context Protocol)

2025年のAIエージェント開発で注目すべきトレンドがMCP(Model Context Protocol)です。

MCPとは

MCPはAnthropicが2024年11月に公開したプロトコルで、AIモデルと外部ツール・データソースを標準化された方法で接続するための仕組みです。

普及状況

- 2024年11月:Anthropic(Claude)が公開

- 2025年3月:OpenAIが採用を表明

- 2025年4月:Google DeepMindが採用を表明

- 2025年6月:LangChainが公式サポート

MCPに対応したフレームワークを選ぶことで、将来の拡張性が高まります。

組み合わせパターン

実際のプロジェクトでは、複数のフレームワークを組み合わせて使うケースも多いです。

パターン1:CrewAI + LangChain

CrewAIでマルチエージェントのオーケストレーションを行い、LangChainをプロンプトフォーマット、メモリ、ツール連携に活用。

パターン2:CrewAI + LlamaIndex

LlamaIndexをデータリトリーバーとして使用し、その結果をCrewAIエージェントに渡して分析・処理。

パターン3:LangGraph + LlamaIndex

LangGraphで複雑なワークフローを構築し、LlamaIndexでRAG機能を提供。

よくある選定ミスと対策

ミス1:人気だけで選ぶ

問題:「LangChainが一番人気だから」という理由だけで選択

対策:ユースケースに合ったフレームワークを選ぶ。シンプルなタスクにはCrewAIの方が適切な場合も

ミス2:学習コストを軽視

問題:LangGraphの柔軟性に惹かれるが、学習に時間がかかり開発が遅延

対策:チームのスキルレベルを考慮。初心者が多い場合はCrewAIから始める

ミス3:将来の拡張性を考慮しない

問題:プロトタイプには十分だが、本番運用でスケールしない

対策:本番運用を見据えた場合はLangChain/LangGraphを検討

AIエージェント開発のご相談

「どのフレームワークを選べばいいかわからない」「プロトタイプから本番運用への移行に課題がある」——そんなお悩みをお持ちではありませんか?

AQUA合同会社のAIエージェント開発支援

AQUA合同会社では、AIエージェント開発を技術面からサポートしています。

- フレームワーク選定支援:ユースケースに最適な技術スタックを提案

- PoC開発:LangChain、CrewAI、LlamaIndex等での実装

- 本番環境構築:スケーラブルなアーキテクチャ設計

- RAGシステム構築:社内データとの連携

- ChatGPT、Claude、Gemini対応:マルチLLM対応

まとめ:プロジェクトに最適なフレームワークを選ぶ

本記事のポイントをまとめます:

☑️ LangChain/LangGraph:複雑なワークフロー、本番運用向け(学習コスト高)

☑️ CrewAI:ロールベースのチーム協調、初心者〜中規模向け

☑️ AutoGen:会話駆動型、ブレスト・カスタマーサポート向け

☑️ LlamaIndex:RAG・データ検索特化、他と組み合わせ可能

☑️ MCP対応が2025年のトレンド、将来の拡張性を考慮

☑️ 組み合わせパターンも検討(CrewAI + LlamaIndex等)

「最も人気のあるフレームワークを選ぶ」のではなく、特定のプロジェクトニーズに能力をマッチさせることが成功の鍵です。

まずは小規模なPoCで複数のフレームワークを試し、チームに合ったものを選択することをおすすめします。