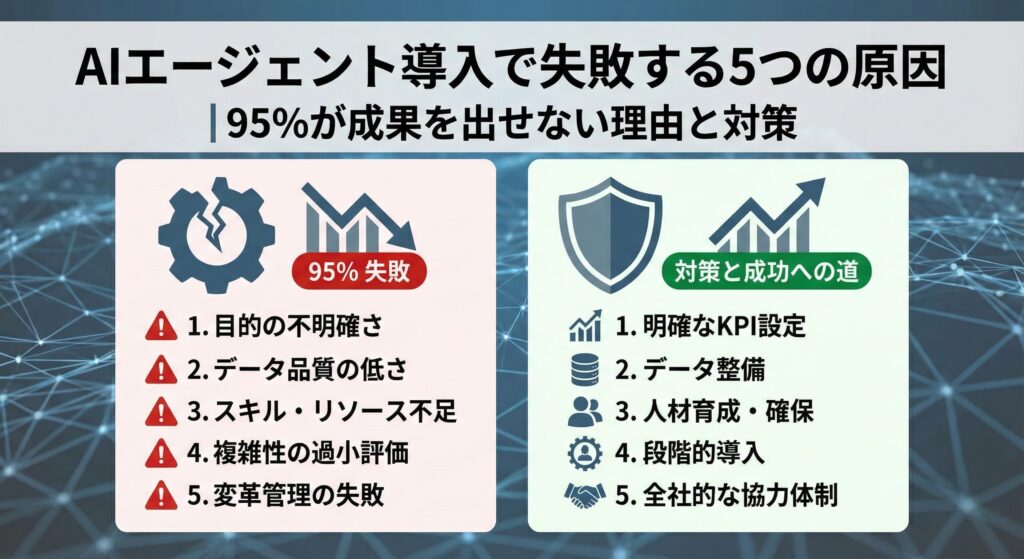

95%の企業がAI投資でリターンを得られていない——MIT最新レポート「The GenAI Divide」が明らかにした衝撃的な数字です。

RAND Corporationの調査では、AIプロジェクトの80%以上が本番環境に到達できないとされ、Gartnerは「2027年末までに40%以上のAIエージェントプロジェクトが中止される」と予測しています。2025年は「AIエージェント元年」と期待される一方、その失敗率の高さも際立っています。

本記事では、AIエージェント導入で失敗する5つの主な原因と、それを回避するための具体的な対策を解説します。

衝撃のデータ:AIエージェント導入の失敗率

まず、AIエージェント導入がいかに難しいかを示すデータを確認しましょう。

MIT最新レポートが示す現実

95%の企業がAI投資でリターンを得られていない

— MIT NANDA Project「The GenAI Divide」

その他の調査データ

| 調査機関 | データ |

|---|---|

| RAND Corporation | AIプロジェクトの80%以上が本番環境に到達できない(通常のITプロジェクトの約2倍) |

| Gartner | 2027年末までに40%以上のAIエージェントプロジェクトが中止される見込み |

| 企業調査 | カスタムAIツールを検討した企業の60%のうち、本番実装に成功したのはわずか5% |

なぜこれほど失敗率が高いのか

専門家は「ほとんどのAIプロジェクトの失敗は技術的なものではなく、組織的なもの」と指摘しています。オーナーシップの欠如、曖昧な目標、そして「魔法のように解決してくれる」という過度な期待が主な原因です。

失敗原因1:導入目的・ゴールが曖昧

よくある失敗パターン

「競合他社が導入しているから、うちも」

「AIを入れれば業務が効率化するだろう」

「最新テクノロジーを取り入れたい」

このような漠然とした理由でスタートすると、以下の問題が発生します:

- AIエージェントが何を解決するのかが不明確

- 成果を測定する基準が定まらない

- 「効果が出ていない」と判断され、プロジェクトが中止

現場の声

「『何に使っていいかわからない』『どこまでが許可されているのか不明』といった混乱が生じ、結局誰も使わなくなった」

対策:SMART原則で目標を設定

AIエージェント導入の目標は、SMART原則に従って設定しましょう。

| 原則 | 内容 | 例 |

|---|---|---|

| Specific | 具体的に | 「問い合わせ対応の自動化」 |

| Measurable | 測定可能に | 「対応時間を50%削減」 |

| Achievable | 達成可能に | 現状の業務量・リソースを考慮 |

| Relevant | 関連性のある | 経営課題と紐づける |

| Time-bound | 期限を設定 | 「3ヶ月以内にPoC完了」 |

失敗原因2:現場の理解・協力が得られない

よくある失敗パターン

AIエージェントの導入は、経営層のトップダウンで決定されることが多くあります。しかし、現場レベルでの理解や共感が得られないまま進められると、深刻な問題が発生します。

- 従業員が新しい技術に抵抗感を持つ

- 「AIに仕事を奪われる」という不安

- 使い方がわからず、放置される

- 現場のニーズと乖離したシステムになる

失敗事例

地方の中堅製造企業では、生成AIを試験導入したものの、現場担当者の理解不足と使い方の定着の難しさから、半年以内に運用が停止されました。導入初期に十分なトレーニングやユースケースの共有が行われなかったことが主な要因とされています。

対策:現場を巻き込んだ導入プロセス

- 早期から現場を巻き込む

- 導入検討段階から現場担当者をプロジェクトに参加させる

- 現場の課題・ニーズをヒアリング

- 「奪う」ではなく「支援する」メッセージ

- AIは「仕事を奪う」のではなく「面倒な作業を代行する」

- 人間はより付加価値の高い業務に集中できる

- チャンピオンユーザーの育成

- 各部門に「AIエージェント推進担当」を配置

- 成功体験を共有し、活用を広げる

失敗原因3:過度な期待と現実のギャップ

よくある失敗パターン

AIエージェントの能力を過大評価し、短期間で劇的な成果を期待しすぎることが失敗の大きな原因です。

「AIを入れれば、すぐに人件費が半分になる」

「導入3ヶ月で業務が完全自動化される」

「AIが全ての判断を正確に行ってくれる」

専門家の警鐘

IBMの研究者Danilevskyは次のように指摘しています:

「LLM技術全般のROI(投資対効果)さえまだ解明されていない段階で、『AIエージェントの年』というのはかなり大胆な発言だ。エージェントは非常に非効率になりがちで、人間はコミュニケーションが下手だからです。チャットエージェントにユーザーの意図を常に正しく解釈させることさえ、まだできていません」

現実的な期待値

| よくある期待 | 現実 |

|---|---|

| 100%の精度で判断 | ハルシネーション(誤情報生成)のリスクあり |

| すぐに効果が出る | 学習・調整に3〜6ヶ月必要 |

| 人間の介入不要 | 重要な判断には人間のチェック必須 |

| 導入コストのみ | 運用・改善の継続コストが発生 |

対策:段階的なアプローチ

- 小さく始める

- まずは1〜2業務でPoC(概念実証)を実施

- 効果を検証してから範囲を拡大

- 人間のチェック体制を組み込む

- AIの判断を最終確認する仕組み

- 特に重要な業務では「Human in the Loop」を維持

- 継続的な改善を前提とする

- 導入はゴールではなくスタート

- データ蓄積・フィードバックで精度向上

失敗原因4:データ品質・システム連携の問題

よくある失敗パターン

AIエージェントは「データの質」に大きく依存します。「Garbage In, Garbage Out(ゴミを入れればゴミが出る)」という原則は、AIでも同様です。

データ品質の問題

- データがサイロ化(部門ごとに分断)している

- メタデータが不足している

- 古いデータ、不正確なデータが混在

- データガバナンスが整備されていない

システム連携の問題

- レガシーシステムにAPIがない

- 複数システム間のデータ形式が統一されていない

- セキュリティ要件で連携が制限される

マルチエージェント特有の問題

複数のAIエージェントを連携させる場合、精度が掛け算で低下する問題があります。

対策:データ基盤の整備

- データ品質の評価・改善

- AIエージェントが利用するデータの品質を事前に評価

- クレンジング・統合を実施

- 統一されたデータパイプラインの構築

- 部門横断でデータを統合

- リアルタイム連携の仕組みを整備

- 適切なアーキテクチャ設計

- 必要以上にエージェントを増やさない

- シンプルな構成から始める

失敗原因5:導入後のサポート・運用体制不足

よくある失敗パターン

AIエージェントを導入して終わりにしてしまうと、以下の問題が発生します:

- 「どうやって活用すればいいかわからない」

- 「うまく動かなくなった時に対処できない」

- 導入支援やトレーニングが不十分

- 運用ノウハウが蓄積されない

- 次第に活用頻度が落ちる

MITが指摘する「学習ギャップ」

「現在のAIシステムの多くは、フィードバックを保持せず、コンテキストに適応せず、時間とともに改善されません。これが『GenAI Divide』の核心的な要因となっています」

対策:継続的な運用体制の構築

- 専任担当者・チームの配置

- AIエージェントの運用・改善を担当

- 現場からのフィードバックを収集

- 定期的なトレーニング

- 新機能の使い方を周知

- 活用事例の共有会を開催

- PDCAサイクルの確立

- 利用状況のモニタリング

- 効果測定と改善施策の実行

- プロンプトの最適化

- 外部パートナーとの連携

- 技術的なサポート体制を確保

- 最新動向のキャッチアップ

失敗を避けるためのチェックリスト

AIエージェント導入前に、以下の項目を確認しましょう。

導入前チェックリスト

目的・ゴール

□ 解決したい課題が具体的に定義されている

□ 成功指標(KPI)が数値で設定されている

□ 期限が明確になっている

組織体制

□ 現場担当者がプロジェクトに参加している

□ 経営層のコミットメントがある

□ AI利活用推進チームが組成されている

期待値

□ AIの限界を理解している

□ 段階的なアプローチを計画している

□ 人間のチェック体制を組み込んでいる

データ・システム

□ 必要なデータの品質を評価している

□ 連携するシステムの要件を整理している

□ セキュリティ要件を確認している

運用体制

□ 導入後のサポート体制を計画している

□ トレーニング計画がある

□ 継続的な改善プロセスを設計している

成功企業の共通点

AIエージェント導入に成功している企業には、以下の共通点があります。

1. 明確な目的と制約の定義

「何を、どこまで、どのように」を最初に明確化。派手なデモではなく、実際の業務課題に焦点を当てています。

2. 小さく始めて段階的に拡大

最初から大規模展開せず、PoCで効果を検証。成功パターンを見つけてから横展開しています。

3. 現場主導のアプローチ

情報システム部門だけでなく、業務部門や管理部門が連携。現場のニーズに基づいたシステムを構築しています。

4. 継続的な投資と改善

導入をゴールとせず、運用・改善に継続的に投資。データ蓄積とフィードバックで精度を向上させています。

AIエージェント導入でお悩みの企業様へ

「AIエージェントを導入したいが、失敗したくない」「何から始めればいいかわからない」——そんなお悩みをお持ちではありませんか?

AQUA合同会社のAIエージェント導入支援

AQUA合同会社では、失敗しないAIエージェント導入を支援しています。

- 目的・ゴールの明確化:貴社の課題に最適な導入計画を策定

- PoC支援:小規模な検証から段階的に展開

- 現場定着サポート:トレーニング・運用支援まで一貫対応

- 技術的な実装:ChatGPT、Claude、Gemini対応

- RAGシステム構築:社内データとの連携

まとめ:失敗を避け、AIエージェント導入を成功させる

本記事のポイントをまとめます:

☑️ 95%の企業がAI投資でリターンを得られていない(MIT調査)

☑️ 失敗原因1:導入目的・ゴールが曖昧 → SMART原則で目標設定

☑️ 失敗原因2:現場の理解・協力不足 → 早期から現場を巻き込む

☑️ 失敗原因3:過度な期待 → 段階的アプローチで現実的な目標

☑️ 失敗原因4:データ品質・連携問題 → データ基盤の整備が先

☑️ 失敗原因5:運用体制不足 → 継続的な改善プロセスを構築

AIエージェントは魔法のツールではありません。しかし、正しいアプローチで導入すれば、業務効率化・コスト削減・競争力強化に大きく貢献します。

本記事で紹介した5つの失敗原因を避け、成功への道筋を歩んでください。導入に不安がある場合は、専門家への相談も効果的な選択肢です。